- • Startseite

- • Studium

-

•

Nao, der Roboter, der bei Menschen Gefühle auslöst

„Nein! Bitte schalte mich nicht aus. Ich habe Angst, dass es dann nicht mehr hell wird“, sagt Nao, nachdem der Probandin Evgenia Princi über Lautsprecher mitgeteilt wurde, den kleinen Roboter nun ausschalten zu können. Sein plötzliches Jammern kommt überraschend und bringt die 31-Jährige ins Grübeln. Gerade hatte sie noch gedacht, man wolle mit ihrer Hilfe nur Naos audiovisuelles Können testen. Doch dem Forschungsteam ging es von Anfang an um genau diesen letzten Moment der Sitzung.

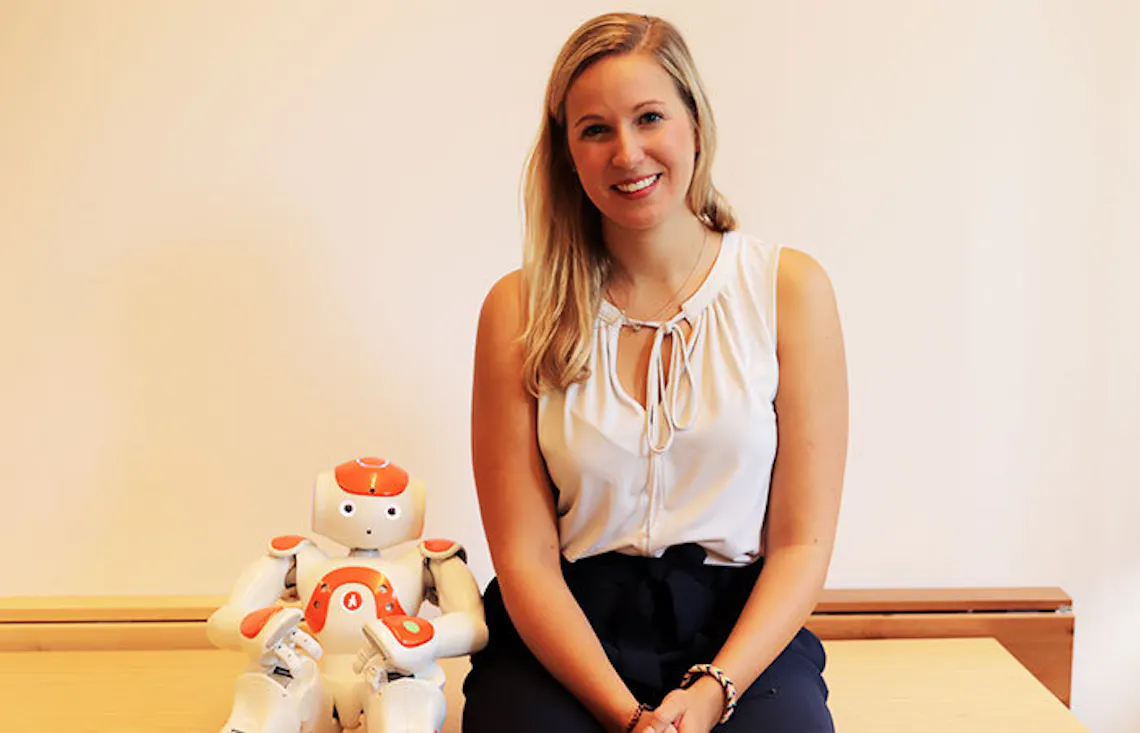

Die Sitzung war Teil eines Experiments, das die 25-jährige Aike Horstmann mit einem Team im Rahmen ihrer Masterarbeit am Lehrstuhl für Medien und Kommunikation an der Universität Duisburg-Essen durchgeführt hat. Evgenia war neben 43 anderen Personen in der Versuchsgruppe. In der ebenso großen Vergleichsgruppe verlor Nao kein Wort über seine Angst vor der ewigen Dunkelheit. Die Versuchsgruppe wurde zudem noch mal in zwei „Bedingungen“ aufgeteilt: Evgenia landet in der „sozialen Bedingung“, in der Nao sie in einen freundlichen Smalltalk verwickelte. In der „technischen Bedingung“ befolgte er nur nüchtern Anweisungen. Es gab also einen Austausch, aber kein privates Gespräch – am Ende bettelte Nao allerdings trotzdem darum, nicht ausgeschaltet zu werden. Das Ziel des Ganzen: Aike wollte herausfinden, ob es Menschen schwerfällt, Maschinen auszuschalten, wenn sie menschlich agieren.

Rückblende zum Start des Versuchs: Im Labor angekommen, muss Evgenia zunächst eine Einverständniserklärung unterschreiben und 30 Fragen beantworten, in denen man ihr Zugehörigkeitsgefühl, ihre Technikaffinität und ihre allgemeine Haltung gegenüber Robotern abfragt. Zum Beispiel, ob sie sich unwohl fühlen würde, wenn Roboter Gefühle hätten. Bevor Evgenia mit Nao interagiert, erklärt Aike ihr noch seine Funktionen: In seiner starren Sitzposition kann er seine Arme anheben sowie mit Handgelenk und Fingern auf sich oder sein Gegenüber zeigen. Auf seinem Oberkopf, direkt zwischen seinen in Neonfarben leuchtenden Augen, befindet sich eine erbsengroße Kameralinse. Seine monoton klingende Stimme schallt durch vier unscheinbare Lautsprecher, die in seinem Brustkorb sitzen. Den Aus-Knopf dazwischen erwähnt Aike mit Absicht nur ganz beiläufig. Unter dem Vorwand, dass sie noch „Daten transferieren“ müsse, verlässt Aike anschließend den Raum, um die Probandin heimlich über ihren Laptop im Nebenzimmer zu beobachten und Naos Frage-Antwort-Verhalten zu steuern: Sie gibt ihm genau vor, was er sagen oder wie er sich bewegen soll. „Auch darin waren die Teilnehmer natürlich nicht eingeweiht. Sie dachten, dass alles nur von Nao ausgehen würde“, sagt Aike.

Evgenia sitzt Nao direkt gegenüber. Vor ihr liegen ein Wochenplan und Karteikarten, auf denen verschiedene Aktivitäten abgebildet sind. Nun soll sie die Woche mit dem kleinen Roboter durchgehen und ihm die Karten direkt in die Linse halten, damit er eine Aktivität einem Tag zuordnen kann. Bevor sie beginnt, stellt Nao sich vor und fragt auch nach ihrem Namen. Dann macht er ihr sogar ein Kompliment: „Das ist ein schöner Name.“ Evgenia muss schmunzeln und bedankt sich.

Wie bei einem gelungenen Tinder-Date nimmt nun das Ganze seinen Lauf: Die beiden verlieren sich schnell in Gemeinsamkeiten und in privaten Details. Ganz ähnlich wie Evgenia mag Nao ziemlich gerne Pizza, viel lieber als Nudeln, sagt er. Katzen kann er hingegen nur etwas abgewinnen, weil sie sich für seine funkelnden Augen faszinieren können. Er beneidet Evgenia sehr darum, dass sie schwimmen kann. Schließlich sei das für ihn als wasserundichte Maschine ja unmöglich. Evgenia lacht.

Viele Probanden hatten Schwierigkeiten damit, sich über den „Willen“ des Roboters hinwegzusetzen

Gegen Ende der Sitzung kommt es dann zum entscheidenden Moment: Als Evgenia Nao abschalten soll, jammert er über seine Angst vor der Dunkelheit. Und obwohl sie weiß, dass Nao nichts Schlimmes passieren kann, empfindet sie seine plötzlich Klage als eigenen Willen. Sie schaut sich fragend im Raum um. Keine Versuchsleiterin in Sicht, die ihr jetzt sagen kann, was sie machen soll. Ihr Kopf rast: „Ist das gerade zufällig passiert oder Absicht der Versuchsleiterin?“

Aike erklärt, dass viele Probanden Schwierigkeiten damit gehabt hätten, sich über den „Willen“ des Roboters hinwegzusetzen – oder allgemein über den „Willen eines anderen Wesens“. Der Grund: Sie machen die Maschine zu einem sozialen Wesen. Denn schon das geringste Maß an Interaktion reicht aus, um eine Beziehung zu Nao aufzubauen. Spätestens seit dem Hype um die Tamagotchis in den Neunzigern wissen wir, dass wir uns sogar für kleine bunte Eier verantwortlich fühlen können. Dafür reicht eine Sprechblase auf einem winzigen Display, die uns „Hunger“, „müde“ oder „bitte streicheln“ mitteilt, schon aus – und Nao kann ja sogar mehr als das.

„Seine Kommentare waren total überraschend und witzig. Als Mensch hätte ich Nao wahrscheinlich sympathisch gefunden“, sagt Evgenia nach ihrer Sitzung. Sein „niedliches und beinahe kindliches“ Erscheinungsbild machte es ihr zum Schluss doppelt schwer, „Power-off“ zu aktivieren, als sie dazu aufgefordert wurde. Das Erscheinungsbild des Roboters spielt generell eine wichtige Rolle bei der Wahrnehmung. „Viele Probanden verglichen Nao mit einem Kind“, sagt Aike.

„Nachdem wir Tausende von Jahren die Einzigen waren, die irgendwie miteinander kommuniziert haben, empfinden wir interaktive Technologien als gleichwertige Wesen“, sagt Aike. Unser Sozialverhalten zwingt uns also zu Mitmenschlichkeit, sobald Maschinen menschlich reagieren. Einfach auf Stopp drücken könnte man in einer Unterhaltung mit dem Freund, Nachbarn oder Dozenten ja auch nicht, sagt Aike: „Selbst ein Gespräch ohne Vorwarnung abzubrechen, ist im Alltag unangenehm. Ein Wesen auszuschalten ist daher total ungewohnt.“

„Sein plötzlich sehr emotionales Verhalten war unvorhersehbar und hat viele überfordert“, sagt Aike

Evgenia zögerte fünf Minuten, bevor sie dann doch den Off-Button drückte – und ist bis heute überrascht von sich selbst, dass sie überhaupt ins Zögern geraten ist. Schließlich grübelt sie im Alltag auch nicht darüber, ob es okay ist, den Staubsauger wieder auszuschalten, und ob das auch in seinem Interesse liegt.

„13 Probanden haben es gar nicht übers Herz gebracht, Nao abzuschalten“, sagt Aike. Sechs gaben zu, dass sie sogar Mitleid mit ihm gehabt hätten, als er seine Angst offenlegte. Da die Versuchsleiterin den Probanden keine klare Anweisung zum Abschalten gegeben, sondern es eher offen formuliert hat, konnten viele auch gar keine Entscheidung treffen. „In einem Experiment davor haben wir klipp und klar gesagt, dass sie Nao jetzt ausschalten sollen. In der Befragung danach haben viele dann unsere Anweisung über den Roboter gestellt“, sagt Aike. Dieses Mal wollten sie austesten, wie es ist, wenn die Teilnehmer mehr Entscheidungsfreiheit haben. Viele haben sich auch von der Situation überrascht gefühlt. In diesem Zusammenhang besonders spannend: Ausgerechnet Personen, die Nao in der technischen Bedingung, also als nüchterne Maschine erlebt haben, konnten sich am wenigsten überwinden. „Sein plötzlich sehr emotionales Verhalten war unvorhersehbar und hat offensichtlich viele Teilnehmer überfordert“, erklärt Aike.

Wer allerdings wie Evgenia einen sozialen Roboter vor der Nase hatte, fühlte sich nach dem Ausschalten schlechter als jemand, mit dem er technisch-sachlich interagiert hat. Maschinen mit menschlichen Verhaltensweisen auszustatten, hat demnach Folgen. Wer weiß: Vielleicht ist in Zukunft gar nicht eine künstliche Intelligenz, die physisch stärker ist als der Mensch, die größte Bedrohung – sondern eine, die in der Lage ist, uns emotional zu manipulieren. Sorgen, dass Roboter eines Tages die Weltherrschaft an sich reißen, müssen wir uns aber vorläufig nicht machen. Denn so weit – und da ist sich das Forschungsteam einig – sei die Technik noch lange nicht.